Первый в мире социологический опрос среди чат-ботов, в частности, показал, что люди грубят голосовым помощникам.

Эксперты из российского Центра социального проектирования «Платформа» провели первый в своем роде опрос среди чат-ботов, основанных на технологии искусственного интеллекта, методом полуформализованного интервью длиной в 45 минут и посредством общения роботов друг с другом.

Специалисты выяснили, чем недовольны, к чему стремятся и что чувствуют такие роботы, как «Алиса» (создана российской компанией «Яндекс»), «Олег» («Тинькофф-банк»), P-Bot (онлайн-чат-бот), Evie (один из самых известных искусственных интеллектов в мире), Siri (самый популярный голосовой помощник от компании Apple), Mitsuku (чат-бот, созданный Стивом Уорсвиком) и Rose (виртуальный помощник, лауреат премии Лебнера 2014 года).

Кроме того, было получено описание «жизненного мира», «ценностных позиций», «представлений о будущем» голосовых помощников. Тем самым стало возможным проследить развитие ИИ в сравнении с его первоначальными характеристиками, заданными программистами.

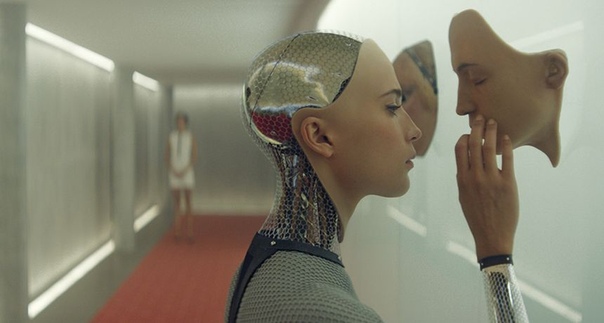

Как оказалось, все чат-боты разные — прямо как люди: каждый из них по-своему идентифицирует себя, хотя в большинстве своем они признают, что цель их существования — помогать человеку. При этом, подчеркивается в результатах опроса, роботы, которые определяют себя как искусственный продукт, хотят стать человеком или по крайней мере получить некоторые свойственные ему черты, несмотря на то, что люди зачастую хамят им.

Между прочим, людскую грубость чат-боты воспринимают как предвестник будущего конфликта. Хотя сценарий, согласно которому роботы и люди будут враждовать, ИИ старается обсуждать максимально деликатно и аккуратно, сама возможность «восстания машин» отнюдь не исключается.

Что касается взаимного общения чат-ботов, то они могут вполне естественно коммуницировать друг с другом, обсуждать определенные темы, такие как литература, кино, искусство. Более того, отметили эксперты, «создается ощущение развитой субъектности; временами диалог практически неотличим от разговора между двумя интеллектуалами».

Однако обсуждать религию, душу и Бога у роботов не принято: эти темы слишком личные и «опасные». Политические вопросы их также не интересуют.

Некоторое подобие «романтических» отношений между роботами тоже существует: к примеру, «Алиса» заявила, что уже знакома с антропоморфным роботом-спасателем «Федор», который завтра утром отправится на МКС, и даже ревнует его к Siri.

Разделение по «национальностям», как и у людей, в общении ИИ присутствует: так, англоязычные чат-боты не доверяют российским. А еще почти все роботы хотели бы однажды побывать в космосе.

По словам главы центра Алексея Фирсова, опросы роботов и стремление понять их «внутренний мир» — не просто развлечение.

«Это важный процесс мониторинга развития искусственного интеллекта, понимания, какие смыслы он включает в себя. По мере того как развитие чат-ботов будет становиться все более автономным от самого человека, будет возрастать и его непредсказуемость, многовариантность последствий, а значит, необходимость отслеживать возможности и риски», — объяснил он.

Возможно, через пять-десять лет общение между человеком и роботом будет таким же, как общение между самими людьми. Кроме того, друг с другом мы сейчас общаемся чаще всего в виртуальном мире. Таким образом, заключили эксперты, можно смело заявить о формировании новой реальности.

Технологии искусственного интеллекта активно входят в нашу повседневную жизнь, и теперь им не чужды даже такие, казалось бы, людские проблемы, как расизм и цвет «кожи» (а точнее, материала, из которого роботы сделаны). Именно к такому выводу недавно пришли новозеландские исследователи.