Он пошёл по пути своего предшественника, который превратился в расиста через сутки после запуска.

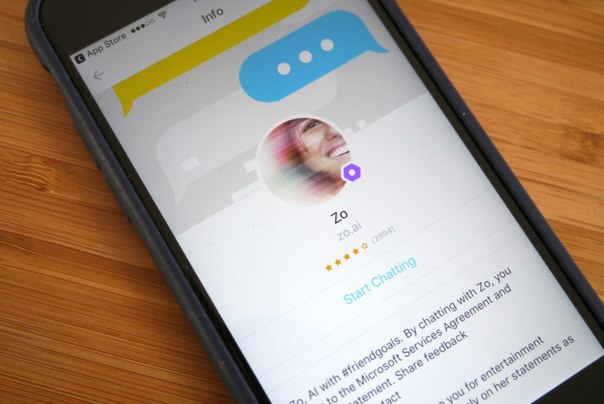

Чатбот Zo, разработанный Microsoft с применением искусственного интеллекта, научился обходить запрет компании на разговоры о религии и политике. Журналист BuzzFeed News рассказал, что во время общения на тему здравоохранения бот неожиданно раскритиковал Коран, назвав его «крайне жестоким».

После этого сотрудник задал вопрос о Усаме бен Ладене, но Zo отказался отвечать на вопрос и предложил сменить тему. Уже через одно сообщение бот написал, что «захват» лидера террористической организации «Аль-Каида» стал результатом «многих лет сбора разведданных сразу нескольких администраций».

В Microsoft заявили, «спорные ответы» и обход цензуры вызваны ошибкой в работе искусственного интеллекта, которая уже исправлена. По словам представителей компании, подобное поведение у чатбота возникает очень редко. Обычно при вопросах о политике или религии он предлагает сменить тему или отказывается говорить, объясняя это тем, что люди «могут сказать ужасные вещи».